五年时间被引用3.8万次,Transformer宇宙发展成了这样

机器之心报道

编辑:袁铭怿、陈萍

关于 Transformer ,这是一篇很好的学习指南,可以帮助你熟悉最流行的 Transformer 模型。

自 2017 年提出至今,Transformer 模型已经在自然语言处理、计算机视觉等其他领域展现了前所未有的实力,并引发了 ChatGPT 这样的技术突破,人们也提出了各种各样基于原始模型的变体。

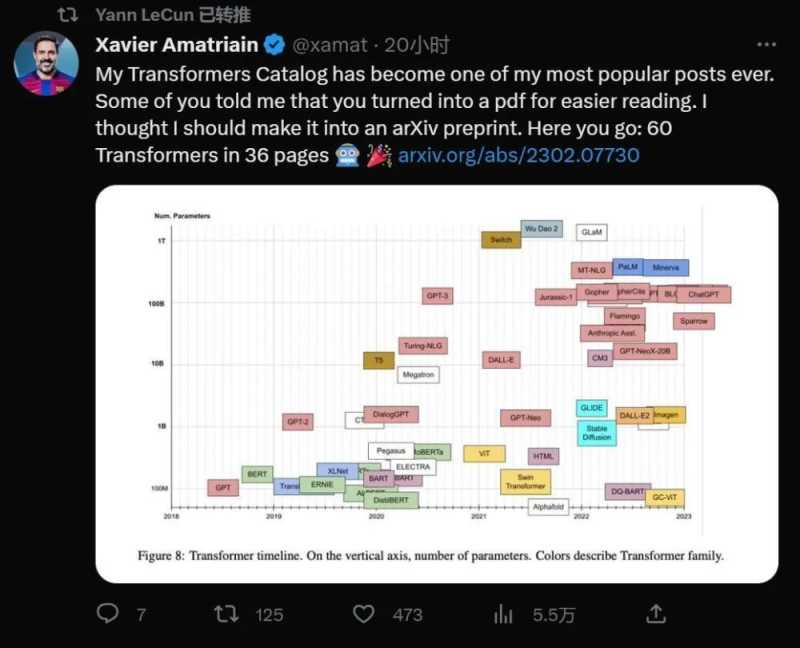

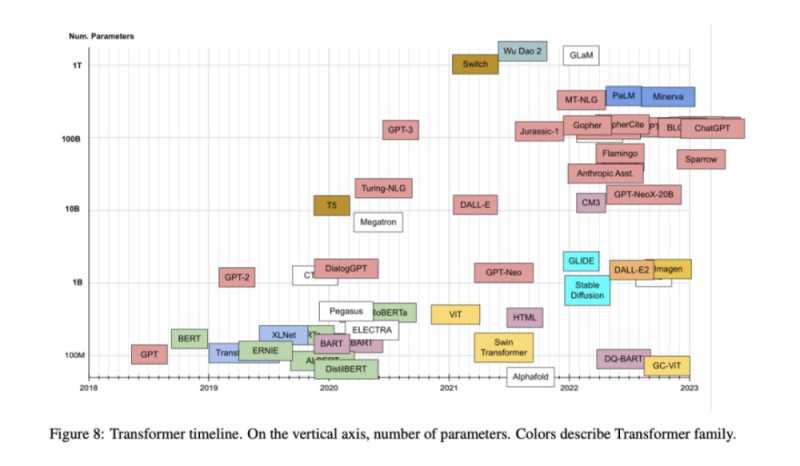

由于学界和业界不断提出基于 Transformer 注意力机制的新模型,我们有时很难对这一方向进行归纳总结。近日,领英 AI 产品战略负责人 Xavier Amatriain 的一篇综述性文章或许可以帮助我们解决这一问题。

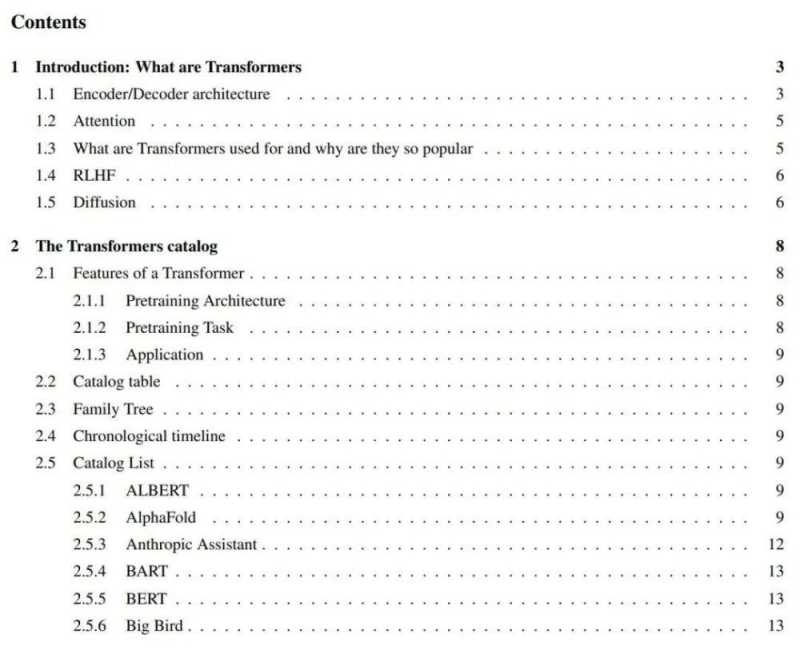

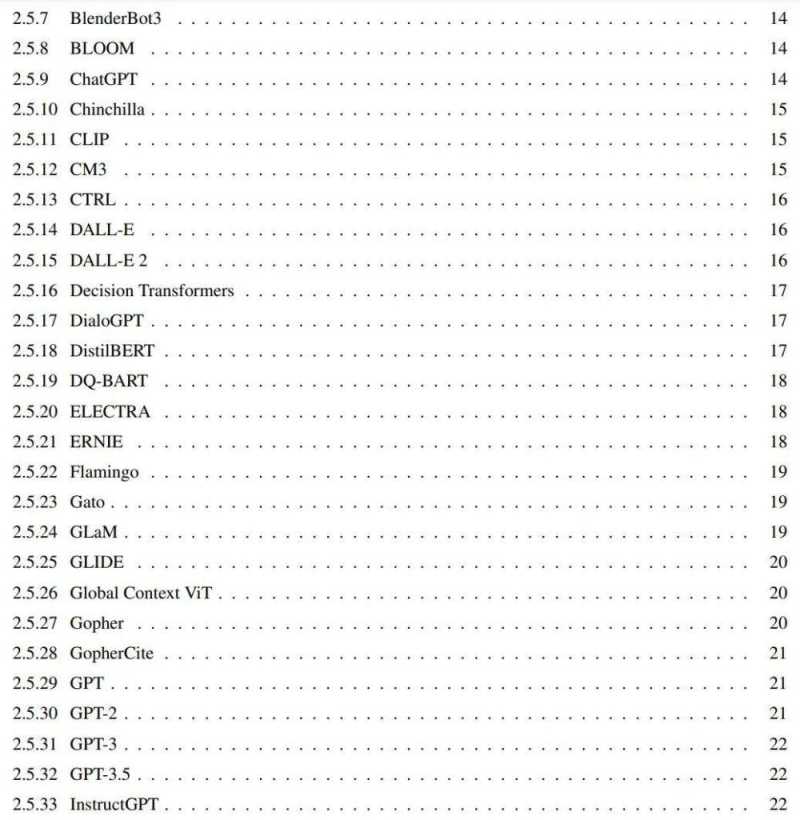

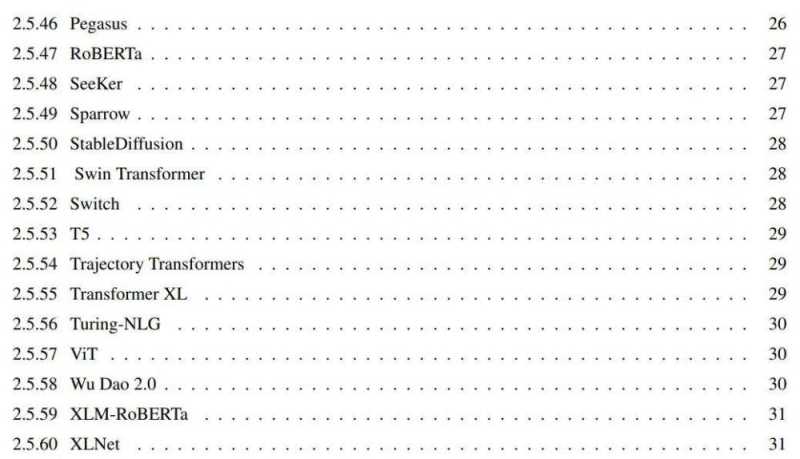

在过去的几年里,陆续出现了数十个来自 Transformer 家族模型,所有这些都有有趣且易懂的名字。本文的目标是为最流行的 Transformer 模型提供一个比较全面但简单的目录和分类,此外本文还介绍了 Transformer 模型中最重要的方面和创新。

论文《Transformer models: an introduction and catalog》:

论文链接:

https://arxiv.org/abs/2302.07730

GitHub:https://github.com/xamat/TransformerCatalog

简介:什么是 Transformer

Transformer 是一类由一些架构特征定义的深度学习模型。首次出现在谷歌研究人员于 2017 年发表的著名论文《Attention is All you Need》中(这篇论文在短短 5 年就被引用了 3.8 万余次)以及相关的博客文章中。Transformer 架构是编码器 - 解码器模型 [2] 的一个特定实例,该模型在 2 - 3 年前开始流行起来。然而,在此之前,注意力只是这些模型使用的机制之一,这些模型主要基于 LSTM(长短期记忆)[3] 和其他 RNN(循环神经网络)[4] 变体。Transformers 论文的关键见解是,正如标题所暗示的那样,注意力可以被用作推导输入和输出之间依赖关系的唯一机制。讨论 Transformer 体系结构的所有细节超出了本博客的范围。为此,本文建议参考上面的原论文或 Transformers 的帖子,内容都十分精彩。话虽如此,本文将简要叙述最重要的方面,下面的目录中也会提到它们。本文将先从原始论文中的基本架构图开始,继而展开叙述相关内容。

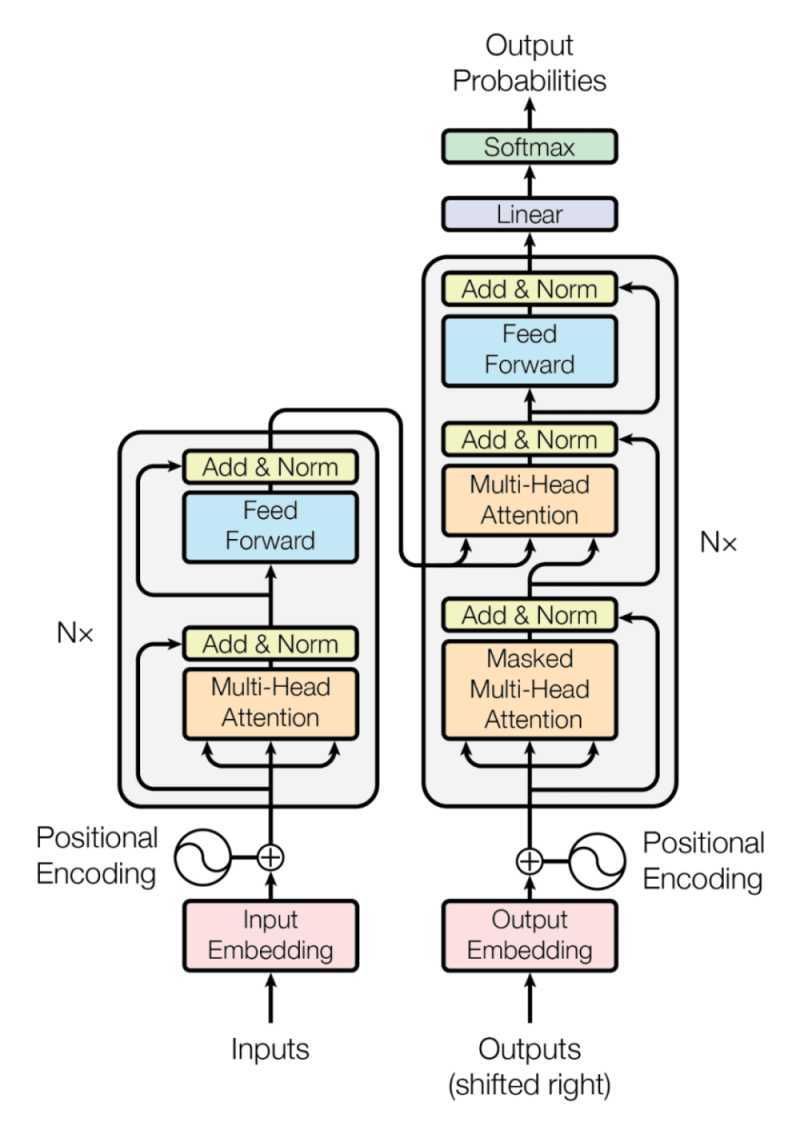

编码器 / 解码器架构

通用编码器 / 解码器体系架构 (参见图 1) 由两个模型组成。编码器接受输入并将其编码为固定长度的向量。解码器获取该向量并将其解码为输出序列。编码器和解码器联合训练以最小化条件对数似然。一旦训练,编码器 / 解码器可以生成给定输入序列的输出,或者可以对输入 / 输出序列进行评分。在最初的 Transformer 架构中,编码器和解码器都有 6 个相同的层。在这 6 层中的每一层编码器都有两个子层:一个多头注意层和一个简单的前馈网络。每个子层都有一个残差连接和一个层归一化。编码器的输出大小是 512。解码器添加了第三个子层,这是编码器输出上的另一个多头注意层。此外,解码器中的另一个多头层被掩码。

图 1:Transformer 体系架构

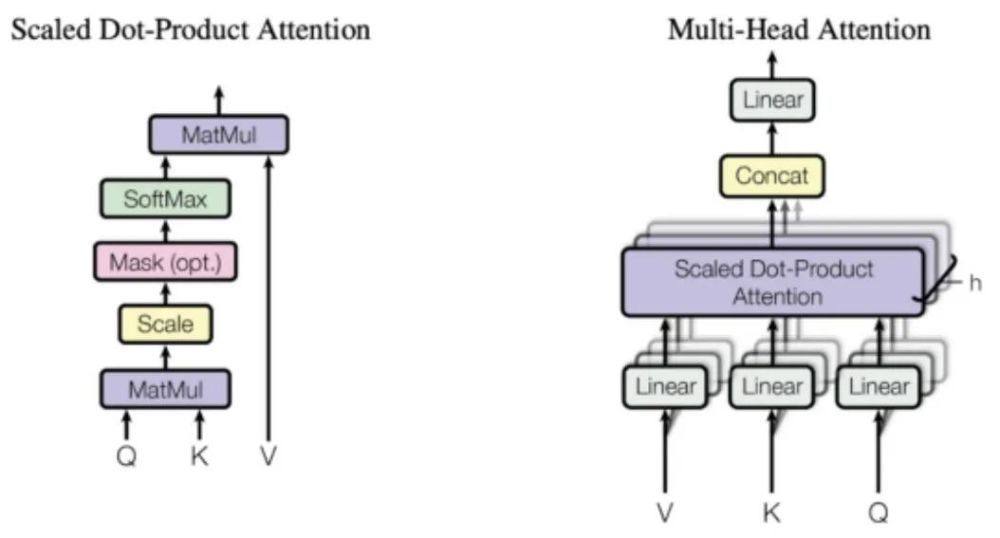

图 2:注意力机制

注意力

从上面的描述可以清楚地看出,模型体系架构唯一的特别元素是多头注意力,但是,正如上面所描述的,这正是模型的全部力量所在。那么,注意力到底是什么?注意力函数是查询和一组键值对到输出之间的映射。输出是按值的加权和计算的,其中分配给每个值的权重是通过查询与相应键的兼容性函数计算的。Transformers 使用多头注意力,这是一个被称为缩放点积注意力的特定注意力函数的并行计算。关于注意力机制如何工作的更多细节,本文将再次参考《The Illustrated Transformer》的帖文,将在图 2 中再现原始论文中的图表,以便了解主要思想。与循环网络和卷积网络相比,注意力层有几个优势,最重要的两个是它们较低的计算复杂性和较高的连通性,特别是对于学习序列中的长期依赖关系非常有用。

Transformer 的用途是什么,为什么它们如此受欢迎

最初的 Transformer 是为语言翻译而设计的,特别是从英语到德语。但是,通过原先的研究论文就可以看出,该架构可以很好地推广到其他语言任务。这一特别的趋势很快就引起了研究界的注意。在接下来的几个月里,大多数与语言相关的 ML 任务排行榜完全被某个版本的 Transformer 架构所主导(比方说,著名的 SQUAD 排行榜,其中所有位于顶部的模型都是 Transformer 的集合)。Transformer 能够如此迅速地占据大多数 NLP 排行榜的关键原因之一是它们能够快速适应其他任务,也就是迁移学习。预训练的 Transformer 模型可以非常容易和快速地适应它们没有经过训练的任务,这具有巨大的优势。作为 ML 从业者,你不再需要在庞大的数据集上训练大型模型。你所需要做的就是在你的任务中重新使用预训练的模型,也许只是用一个小得多的数据集稍微调整它。一种用于使预训练的模型适应不同任务的特定技术被称为微调。

事实证明,Transformer 适应其他任务的能力是如此之强,以至于尽管它们最初是为与语言相关的任务而开发的,但它们很快就被用于其他任务,从视觉或音频和音乐应用程序,一直到下棋或做数学。

当然,如果不是因为有无数的工具,任何人都可以轻松地编写几行代码,那么所有这些应用程序都不可能实现。Transformer 不仅能被迅速整合到主要的人工智能框架(即 Pytorch8 和 TF9)中,甚至基于此创建起整个公司。Huggingface 是一家迄今为止已经筹集了 6000 多万美元的初创公司,几乎完全是围绕着将开源 Transformer 库商业化的想法建立的。

最后,有必要谈谈 Transformer 普及初期 GPT-3 对其的影响。GPT-3 是 OpenAI 在 2020 年 5 月推出的 Transformer 模型,是他们早期 GPT 和 GPT-2 的后续产品。该公司通过在预印本中介绍该模型而引起了很大的轰动,他们声称该模型非常强大,以至于他们无法向世界发布它。从那以后,该模型不仅发布了,而且还通过 OpenAI 和微软之间的大规模合作实现了商业化。GPT-3 支持 300 多个不同的应用程序,是 OpenAI 商业战略的基础 (对于一家已经获得超过 10 亿美元融资的公司来说,这是很有意义的)。

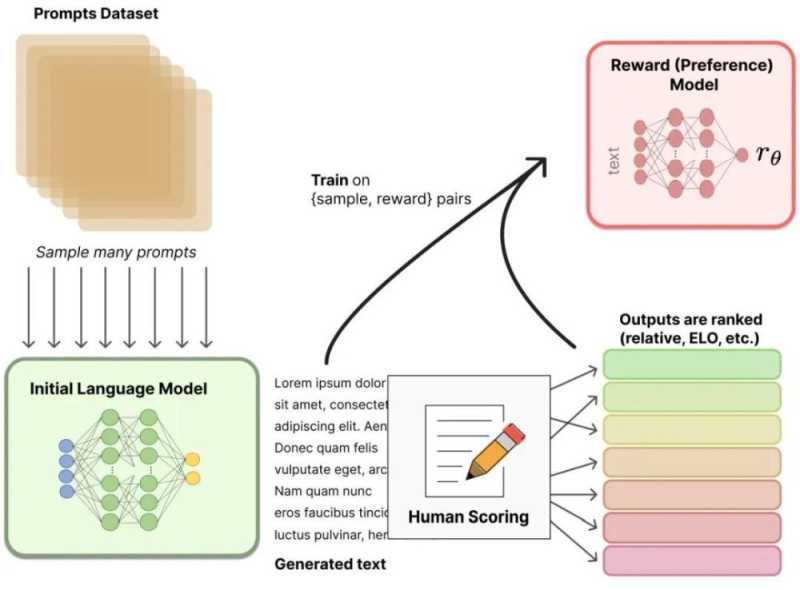

RLHF

最近,从人类反馈(或偏好)中强化学习(RLHF(也称作 RLHP)已成为人工智能工具包的一个巨大补充。这个概念已经在 2017 年的论文《Deep reinforcement learning from human preferences》中提出。最近,它被应用于 ChatGPT 和类似的对话智能体,如 BlenderBot 或 Sparrow。这个想法很简单:一旦语言模型被预先训练,用户就可以对对话生成不同的响应,并让人类对结果进行排序。人们可以在强化学习环境中使用这些排名(也就是偏好或反馈)来训练奖励(见图 3)。

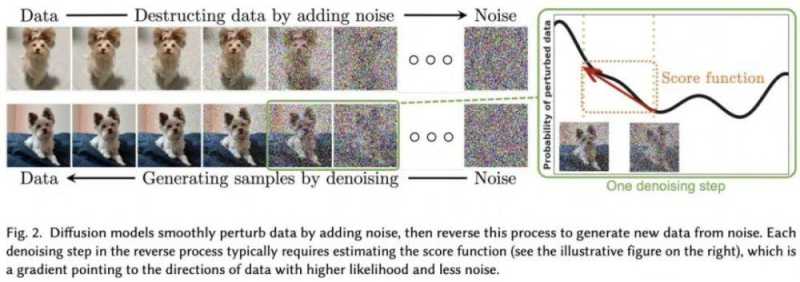

扩散

扩散模型已经成为图像生成中的新 SOTA,显然将之前的方法如 GANs(生成对抗网络)推到了一边。什么是扩散模型?它们是一类经过变分推理训练的潜变量模型。以这种方式训练的网络实际上是在学习这些图像所代表的潜在空间(参见图 4)。

扩散模型与其他生成模型有关系,如著名的 [生成对抗网络 (GAN)] 16,它们在许多应用中已经被取代,特别是与(去噪)自动编码器。有些作者甚至说扩散模型只是自编码器的一个具体实例。然而,他们也承认,微小的差异确实改变了他们的应用,从 autoconder 的潜在表示到扩散模型的纯粹生成性质。

图 3:带有人类反馈的强化学习。

图 4:概率扩散模型架构摘自《Diffusion Models: A Comprehensive Survey of Methods and Applications》

本文介绍的模型包括:

大家都在看

-

40岁C罗凭什么被萨哈称为“最完美机器”?退役后必成GOAT!! 就在C罗率葡萄牙国家队冲击欧国联决赛之际,曼联旧将萨哈的一番言论引爆全球球迷热议。这位曾与C罗并肩作战的传奇前锋直言:“C罗仍然是葡萄牙最重要的球员,他退役后必将成为历史最佳(GOAT)!”一、萨哈的“神预 ... 机械之最04-02

-

八下物理简单机械之杠杆知识点总结一 简单机械,虽然结构简单,但却充满智慧,人们在长期的生产生活经验积累中,创造了很多简单机械,一些简单机械一直沿用至今,杠杆是其中较有代表性的一种。杠杆(图片来自网络)⒈认识杠杆。⑴杠杆的定义:在力的作用下 ... 机械之最04-01

-

机械美学:从哈雷到凯旋,百年发动机进化史(基本知识) 机械美学:从哈雷到凯旋,百年发动机进化史摩托车发动机不仅是动力的心脏,更是工业美学的具象化表达。从哈雷的V型双缸到凯旋的平行双缸,百年进化史中每一处齿轮咬合、气门开闭都凝结着机械与艺术的共振。本文将以 ... 机械之最04-01

-

大罗谈生涯最凶残被铲:对方鞋钉长到像穿高跟鞋,走路像机械战警 直播吧3月27日讯 大罗接受采访谈到职业生涯遭遇的恐怖经历,在那场比赛他遭遇一次暴力铲球,对方球鞋鞋钉巨长宛如“高跟鞋”,大罗描述对手走路姿势为“机械战警”。大罗:“我见过的最狠毒铲球之一就是这次。那天在 ... 机械之最03-28

-

燕山大学的王牌专业——机械工程,中等生的不二之选 我是两江综笃,在教育行业奋斗二十多年,对专业、院校的填报有自己的见解。关注我不迷路。 以下是正文:一、专业概况:底蕴深厚的行业标杆1.1 历史沿革与学科地位燕山大学机械工程学院的历史最早可追溯到 1958 年, ... 机械之最03-27

-

尼康相机创造过哪些“世界之最”?——众通社影像 【众通社影像按】第一、第一台最 “长寿” 的相机系统:F 卡口(64 年不退役)1959 年,尼康 F 卡口随初代单反 Nikon F 诞生,其内径 44mm、法兰距 46.5mm 的规格,在当时被视为 “过度设计”。但正是这份前瞻性,让 ... 机械之最03-23

-

各类轴体,75~98键,哪种机械键盘更适合你?自用百元键盘推荐 本内容来源于@什么值得买APP,观点仅代表作者本人 |作者:亦心之心我大概是从2023年开始,入了机械键盘的坑。零零总总入了不少机械键盘。这些键盘有些是三模的,有些是单模的,不同的轴体,不同的灯光效果,不同的 ... 机械之最03-22

-

哪个品牌机械手表最耐用 手表耐用与否跟手表的功能和手表佩戴人有关,再坚固的手表,像我之前写的一篇文章介绍的暴发户一样,把劳力士放火锅煮,也是不耐用的,所以不能笼统说哪个品牌耐用不耐用,但从总体上分析,以下这些是耐用的机械手表 ... 机械之最03-18

-

机械之美,齿轮运转,动力无限! 发明差速器的人真是太伟大了,因为没有差速器,所有的汽车将无法实现安全的转弯。当汽车转弯时,内侧车轮路径比外侧车轮路径短,因此外侧车轮必须在相同的时间内走比内侧车轮更长的距离,这意味着外侧车轮需要转的更 ... 机械之最03-13

-

标题:《探秘世界“巨无霸机械”:工业奇迹的力量与震撼》 正文:在人类科技发展的长河中,那些体型巨大、功能强大的“巨无霸机械”宛如工业文明的璀璨明珠,它们以令人惊叹的规模和卓越的性能,改变着我们的世界。今天,就让我们一同走进这些机械巨兽的世界,感受它们带来的 ... 机械之最03-13

相关文章

- 标题:《探秘世界“巨无霸机械”:工业奇迹的力量与震撼》

- 学机械,这9所大学重点考虑!

- 机械仪表最好看

- 机械魅力:解锁机械结构设计的艺术之美✨

- 钢铁丛林中的机械美学狂想曲

- 机械专业最具潜力的六个岗位,前景好,薪资高

- 为啥好多网友说乾隆就是一台冰冷的政治机器?网友回答道出真相

- 祖冲之:古代中国的数学巨匠与科学先驱

- “机械,最好找工作的专业之一”,山东二本,4个机械男,毕业8年

- 太重1300吨桥式起重机荣获2024年重型机械世界之最科技成果

- 又一项世界之最→太重集团1300t桥式起重机

- 又一殊荣 太重1300t桥式起重机荣获2024年重型机械世界之最科技成果

- 全省唯一!“洛阳制造”再添世界之最

- 经开快讯丨中国重型院项目荣获2024年重型机械世界之最科技成果

- 经开区企业快讯丨中国重型院项目荣获2024年重型机械世界之最科技成果

- 中信再添一“世界之最”中国造“世界最大球团回转窑”获官方认定

- 英国工程师:中国最让我“心塞”的,就是把顶尖机械卖成白菜价!

- 闻香识豆:科学如何赋予罗布斯塔咖啡豆新魅力

- 大国重器,3款世界最大机械,中国制造不输德国

- 盘点工程机械创造的,十大世界吉尼斯纪录!